编译/VR陀螺

Meta 的研究人员构建了一个“大型重建模型(LRM)”,该模型仅需四张自拍照,就能在几分钟内生成一个可动的、逼真的头部虚拟化身。

Meta 研究虚拟化身的生成和动画技术至今已有六年多时间了,到目前为止,对于虚拟化身而言,最大的挑战之一就是生成它们所需的数据量和时间。

Meta 质量最高的系统需要使用一套非常昂贵的专业捕捉设备,该设备配备了 100 多个摄像头。该公司曾展示过利用智能手机扫描来生成质量较低的虚拟化身的研究成果,但这需要在三分多钟的时间里做出 65 种面部表情,而且所捕捉到的数据,在一台配备四个高端图形处理器(GPU)的机器上需要花几个小时才能处理完成。

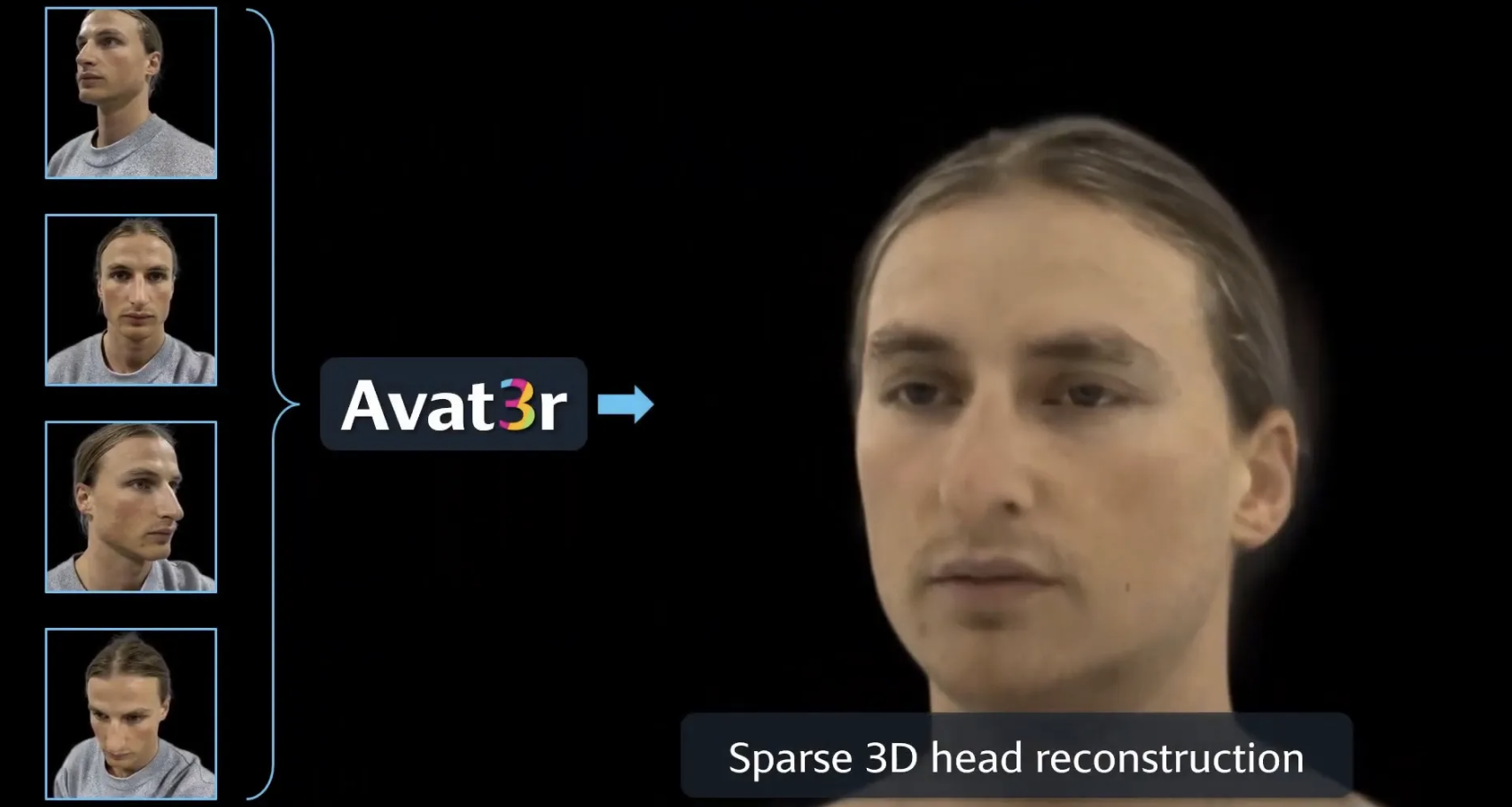

如今,在一篇名为《Avat3r:用于高保真 3D 头部化身的大型可动画高斯重建模型》的新论文中,来自 Meta 和慕尼黑工业大学的研究人员展示了一个系统,该系统仅需四张手机自拍照,就能生成一个可动的、逼真的虚拟化身头部,而且处理时间只需几分钟,而不是数小时。

从技术层面来看,Avat3r系统建立在大型重建模型(LRM)的概念基础之上,就像大语言模型(LLMs)处理自然语言那样,它利用了一种变换器来处理三维视觉任务,这通常被称为视觉变换器(ViT)。这种视觉变换器被用于预测一组三维高斯模型,类似于高斯溅射技术,该技术应用于一些逼真场景中。

尽管 Avat3r 系统生成虚拟化身所需的数据量和计算量非常低,但它远不适合用于实时渲染。据研究人员称,最终的系统在英伟达 RTX 3090 显卡上的运行帧率仅为每秒 8 帧。

不过,在人工智能领域,新想法的后续迭代实现数量级的优化是很常见的,Avat3r 系统的方法为未来指明了一条充满希望的道路:终有一天,头戴设备的用户或许只需拍几张自拍照,再经过几分钟的生成时间,就能创建出一个逼真的虚拟化身。

来源:uploadvr

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息