文/VR陀螺 冉启行

AI 大模型的崛起,已经从根本上改变了用户与信息的交互方式,其中最为显著的冲击莫过于对传统搜索引擎的颠覆。

此前,苹果高管 Eddy Cue 透露,2025 年 Q1 苹果设备上的谷歌搜索查询量首次下降,市场研究机构 Gartner 去年曾预测,到 2026 年,传统搜索引擎的流量将因转向人工智能工具而减少 25%。

作为「AI 大模型的最佳硬件载体」,2024 年爆火的 AI 眼镜也在悄无声息间,逐渐改变人机交互的新模式,同时将战火烧到了我们习以为常的 APP 生态。

凭借多模态 AI 的集成能力,AI 眼镜正在通过 AI Agent 直接调用各类系统级功能和 MCP 服务,绕过传统的 APP 应用商店和独立的软件启动流程。这种“釜底抽薪”式的变革,对原有软件生态的冲击无疑是巨大的。

当然,这种“变革”并非一蹴而就,也非全盘通杀。对于那些追求极致视觉、重度交互体验的游戏内容,或特定专业领域的复杂应用,在 AI 眼镜的性能、显示效果、续航以及交互方式尚未完全媲美甚至超越手机等成熟设备之前,它们仍将拥有较长的生命周期。

从“可穿戴3D显示器”到“智能助理”的进化

回顾智能眼镜的发展历程,早期产品如棱镜方案的 Google Glass 更像是一个信息提示器,而后续的 Magic Leap 2、Hololens2 虽然实现了出色的 3D 显示和空间运算,但高昂的成本与较大的体积限制了其 C 端发展。

许多分体式的 Birdbath 方案产品虽然在一定程度上实现了成本、显示与佩戴的平衡,但其核心功能更侧重于作为手机或电脑的“第二块屏幕”,主要解决的是“随身 3D 大屏显示”的问题。

然而,真正的变量在于 AI,特别是多模态 AI 大模型的融入,不管是与普通拍摄眼镜的结合,还是搭配 AR 光波导类型眼镜,都为智能眼镜在体验上带来了革命性的突破,实现了价值增量。

一个老生常谈的案例是已经突破 200 万市场销量的 Ray-Ban Meta,这款由 Meta 和 EssilorLuxottica 合作推出的产品,不仅仅是外观时尚的眼镜,更内置了 Meta AI。用户可以通过语音指令“Hey Meta”唤醒 AI 助手,进行拍照、录像、听音乐、打电话,甚至进行实时翻译和基于视觉的问答。

一句“Hey Meta, what is this?”,它就能识别并给出信息。这种即时、场景化的 AI 服务,正逐步取代用户掏出手机、解锁、打开特定 APP (如翻译软件、识别软件) 的传统操作。

类似的趋势也出现在其他积极布局 AI 眼镜的厂商中,尤其是商业嗅觉极为灵敏的中国厂商上,对于原本的 AR 眼镜厂商而言,更是“如虎添翼”。在 AI 拍摄眼镜的基础,Rokid 推出了配备了单色 Micro-LED+衍射光波导的 Rokid Glasses,影目推出了配备 AI 大模型的迭代 AR 眼镜产品 INMO Air 3,雷鸟创新打造了深度融入多模态 AI 大模型与全彩 Micro-LED+刻蚀光波导的雷鸟X3 Pro......

通过 AR 显示,这些产品不断强化其一体式 AI 眼镜的能力。通常可集成导航、翻译、信息提示、智能助手等功能,并可通过语音、触控、手势等多模态交互方式,提供更高效的智能服务。在地图导航应用场景下,眼镜可直接在视野中投射导航路径,或者在跨国交流时实时显示翻译字幕,这些都可以极大地提升效率,同时也削弱了用户对手机导航 APP 或翻译 APP 的「低头式」依赖。

工具类APP首当其冲,AI Agent欲“接管”一切

最先感受到这股寒意的,无疑是那些功能相对单一、交互界面相对固定的工具类 APP。对于用户而言,这些应用甚至都不需要过多的视觉交互。

大致包含这几大类:

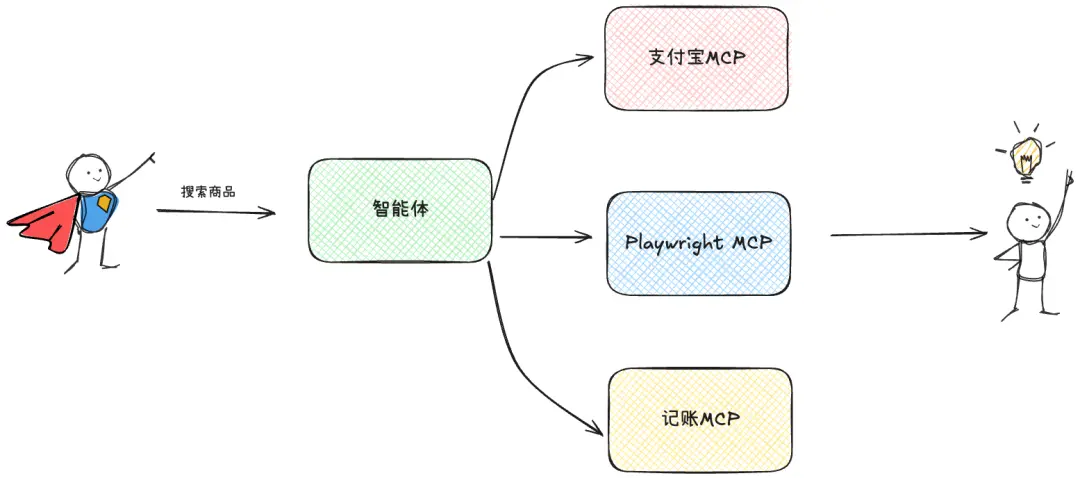

多模态 AI 使得眼镜能够听懂用户的话、看懂眼前的景象,AI Agent 则扮演着“超级管家”的角色,连接并调度各种服务资源。这种模式下,用户不再需要关心背后是哪个 APP 提供了天气信息,哪个 APP 提供了导航服务,AI Agent 会根据指令和场景,自动完成这一切。

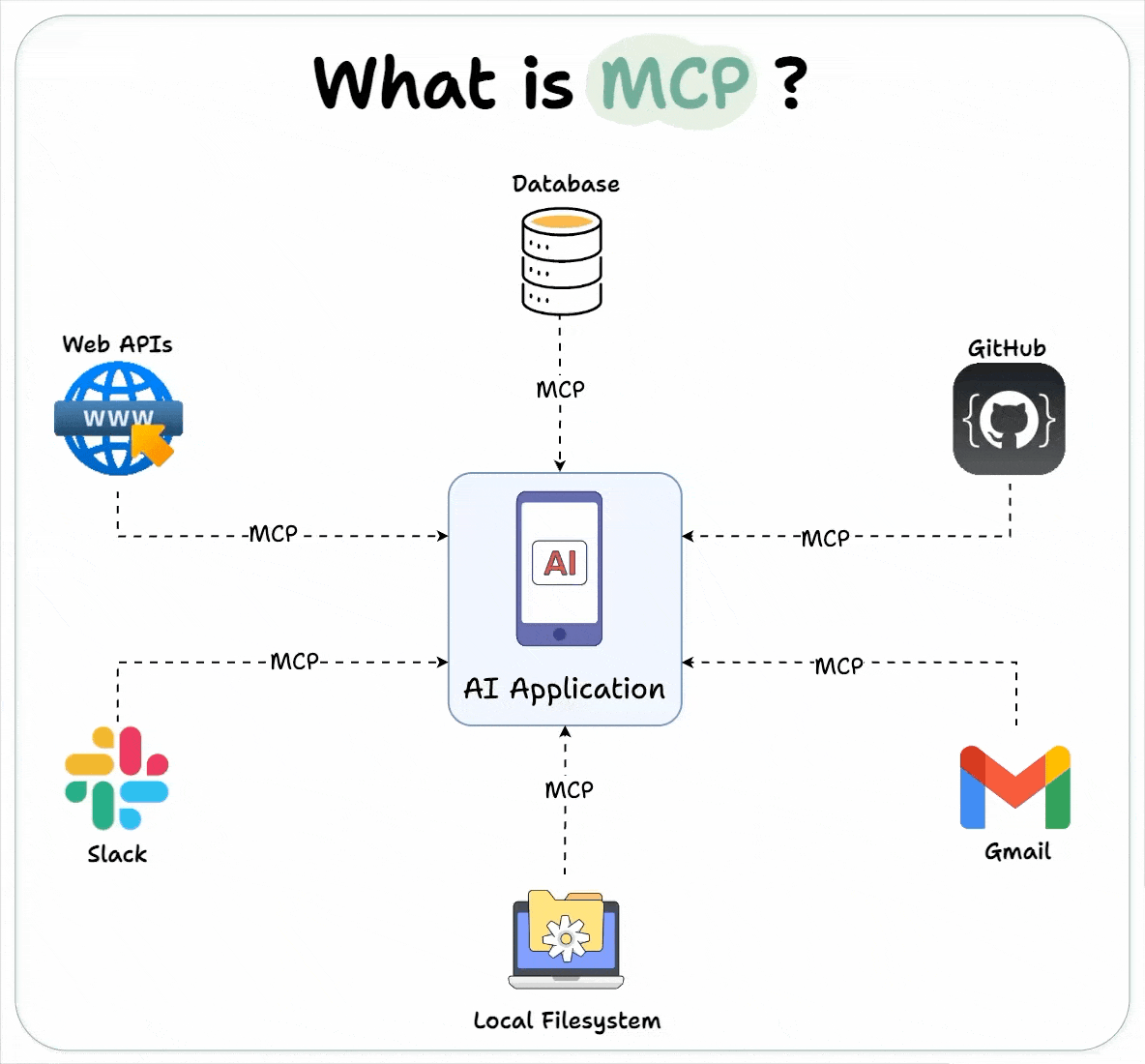

要实现 AI Agent 对纷繁复杂服务的灵活调用,其实还有一个关键的技术——MCP (Model Context Protocol,模型上下文协议)。

MCP 是由 Anthropic 提出并于 2024 年 11 月开源的一种通信协议,旨在解决大型语言模型(LLM)与外部数据源及工具之间无缝集成的需求,可以将其理解为 AI Agent 连接现实世界各种能力的“万能插座”。

短短半年时间,MCP 发展非常迅猛,国内 AI 开源社区魔搭 ModelScope 最新 5 月数据显示,其已经集成了超过 3000 个 MCP Server,覆盖了搜索工具、位置服务、娱乐与多媒体、金融和各类开发者工具等热门和高频应用领域。

这意味着 AI Agent 不再是空有大脑的「理论家」,而是有了可以调用的「手和脚」。AI 大模型的训练的数据往往过于陈旧,无法给出各种实时的准确信息,而通过各种 MCP 服务器,AI Agent 可以实现各种最新数据的获取,如最新的资讯、股价、天气、车票、机票、地图等。甚至在未来,当用户需要预订餐厅或购买电影票时,AI Agent 也能通过 MCP 连接到相应的服务提供方。

所有这些操作,用户都无需打开任何独立的 APP,AI Agent 会在后台默默完成服务的发现、调用与整合,最终将结果直接呈现给用户。

这种基于 MCP 的服务编排能力,使得 AI 眼镜能够真正突破单个 APP 的功能孤岛,将过去分散在不同应用中的能力融为一体,提供连贯、智能的“一站式”服务。传统服务类 APP 也将经历一个转型——可以将自己的核心能力通过 MCP 接口去实现,拥抱新变化。

目前,如高德地图、腾讯地图、百度地图,支付宝、中国银联等知名 APP 都已实现 MCP Server,AI Agent 正在成为新的流量入口和用户触点。MCP 生态的繁荣,无疑将加速 AI 眼镜“杀死”传统 APP 形态的进程,推动交互重心从“以 APP 为中心”转向“以任务和用户意图为中心”。

视觉冲击与复杂交互,游戏等 APP 的“避风港”

尽管 AI 眼镜来势汹汹,MCP 生态也愈加壮大,但并非所有类型的 APP 都会在短期内“束手就擒”。

特别是对视觉效果、沉浸感和操控复杂度要求极高的游戏 APP,以及一些专业领域的生产力工具(如复杂的视频编辑、3D 建模软件、编程软件等),它们在 AI 眼镜上的发展仍面临诸多现实瓶颈。

目前,整个 AI 眼镜产业,依旧面临显示、性能与佩戴的三座大山。近几年,Micro-LED 微显示+光波导的方案经虽有一定突破,但仍未达到媲美手机、电脑级别的理想入眼显示效果,PPD、彩虹纹、透过率等有待进一步改善和提高;

性能方面,低功耗的 SoC 往往无法提供较强性能支持,而较强的芯片却在功耗方面消耗强大,远不是 AI 眼镜 200-300 毫安电池可以折腾的,而较大的电池容量又不符合眼镜轻量级人体工学设计,相互掣肘的技术瓶颈较多;

考虑到整体性能与续航能力,目前 AI 眼镜的人机交互方式主要集中于语音与触控交互,更自然精准的“手眼交互”仍有一很长时间的落地距离,即使真正应用,在某些办公、游戏等场景下,综合体验上还难以媲美手机触屏、实体手柄或键鼠。

因此,在未来相当长一段时间内,追求极致视觉体验和复杂交互的游戏,以及功能纵深极强的专业应用,其主要载体仍会是手机、平板、PC 和 VR 头显。AI 眼镜或许可以作为这些体验的辅助显示或提供某些轻量化的联动功能,但难以完全取代。

AI眼镜狂潮下的APP“形态重塑”

其实,陀螺君这里“杀死 APP 形态”的说法,更准确地理解,应该是指 AI 眼镜正在“杀死”那种用户必须主动寻找、下载、安装、学习并频繁切换的传统 APP 的交互模式,尤其是在处理那些可以通过简单指令和场景感知就能完成的任务。

未来,APP 生态并不会彻底消亡,更有可能的是一种“形态重塑”和“生态共荣”的局面。部分工具类 APP 功能被“吸收”,一些基础工具的功能将被操作系统层级的 AI Agent 或 AI 眼镜的系统功能所吸收,用户不再需要为这些单一功能下载独立 APP。

应用“MCP 化”会是一大趋势,更多的 APP 可能会将自身核心能力封装成 MCP 服务,供 AI Agent 调用。与此同时,APP 开发商的重心可能从打磨独立前端界面转向提供高效、安全的后端服务。

“眼镜端”成为新的入口与交互界面,对于某些应用,AI 眼镜可能成为其一种新的、更便捷的入口和交互界面。例如,地图 APP 可以在眼镜端提供基于增强现实的导航服务,社交 APP 可以在眼镜端提供更即时的信息提醒和 AR 式互动等。

AI 眼镜作为潜在的下一代计算平台,其对现有 APP 形态的冲击是结构性的。它预示着一种更自然、更主动、更情境化的交互范式的到来。在这个范式下,简单的工具类 APP 首当其冲,其功能模块化、服务化,直至被强大的 AI Agent “隐形化”,将是大势所趋。而对于游戏、重度内容等强调沉浸体验和复杂交互的应用,AI 眼镜的硬件瓶颈决定了它们仍有较长的独立发展窗口期。

APP 形态不会轻易消亡,但它必然会在 AI 大模型、AI 眼镜掀起的时代浪潮中,进化出新的模样,而现在这场「变革」才刚刚开始。

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息